人工智能赋能的智能化软件测试 基础软件开发的新范式

在当今软件产业高速发展的时代,软件系统的复杂性、规模和迭代速度都达到了前所未有的高度。传统的软件测试方法,高度依赖人工设计用例、执行脚本和分析结果,在面对现代复杂软件,尤其是底层基础软件时,愈发显得力不从心。效率瓶颈、覆盖率不足、对未知缺陷的探测能力有限等问题日益凸显。与此人工智能技术的迅猛发展,特别是机器学习、深度学习、自然语言处理等领域的突破,为软件测试的智能化变革提供了强大的技术引擎。将人工智能深度融入软件测试全流程,构建“智能化软件测试”体系,已成为提升基础软件开发质量与效率的必然选择。

智能化软件测试的核心,在于利用AI技术模拟、增强乃至超越人类测试专家的部分认知与执行能力。在基础软件开发这一特定领域,其应用价值尤为显著。基础软件,如操作系统内核、数据库系统、编译器等,通常具有代码规模庞大、逻辑结构复杂、对稳定性和性能要求极高等特点。传统的测试方法需要耗费巨大的人力与时间成本才能达到较高的测试充分性。而AI的引入,可以从以下几个关键环节带来革命性提升:

在测试用例的智能生成与优化方面。AI可以通过学习程序代码、历史缺陷数据、规格说明书甚至用户行为日志,自动生成大量、高针对性的测试用例。例如,基于模糊测试(Fuzzing)技术,结合强化学习算法,可以动态调整测试输入的数据生成策略,更高效地探索程序的深层状态空间和边界条件,从而发现那些隐蔽的、需要特定条件触发的安全漏洞或崩溃缺陷。对于基础软件中复杂的API接口和协议,AI能够理解其语义约束,生成既符合语法又富含“攻击性”的测试数据,大幅提升测试的深度和广度。

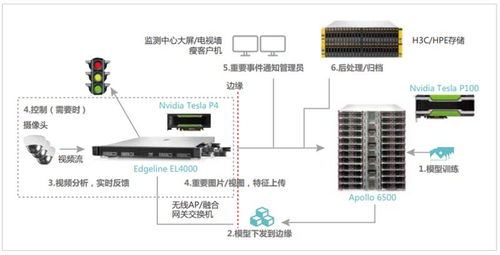

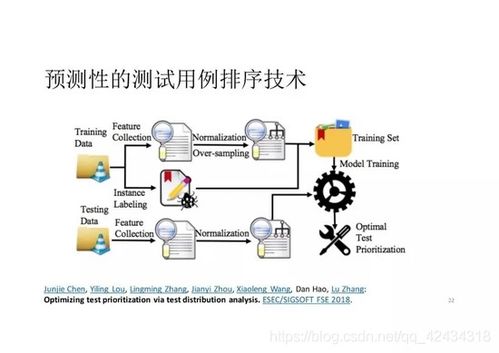

在测试执行的智能调度与优先排序方面。面对成千上万的测试用例,如何高效利用计算资源、快速反馈最可能发现缺陷的测试结果,是一个关键问题。AI模型可以预测测试用例的故障检测概率、执行时间以及对代码变更的敏感度,从而实现测试套件的动态优先级排序和选择性执行。在持续集成/持续交付(CI/CD)流水线中,这种智能调度能够确保在资源有限的情况下,优先运行风险最高的测试,加速开发反馈循环,这对于追求高稳定性的基础软件迭代至关重要。

在测试结果的智能分析与缺陷预测方面。AI能够自动化处理海量的测试执行日志、程序崩溃核心转储(Core Dump)、静态代码扫描报告等。通过模式识别和异常检测技术,它可以自动对测试失败进行分类、聚类,并初步定位可能的根因,甚至将相似的缺陷关联起来,极大减轻测试人员分析海量结果的工作负担。更进一步,基于代码变更历史、开发者协作网络、代码复杂度度量等特征,AI可以构建缺陷预测模型,在代码提交或构建阶段就标识出高风险模块,实现测试资源的精准投放,变“事后检测”为“事前预防”。

在测试维护的智能适应方面。基础软件处于持续演进中,代码的每一次变更都可能使部分原有测试用例失效(即产生“测试坏味道”)。AI可以自动分析代码变更与测试用例之间的影响关系,识别出需要更新或废弃的测试,并辅助甚至自动完成测试用例的演化与修复,保证测试资产与软件版本同步,维持测试套件的长期健康度。

将人工智能应用于基础软件的智能化测试也面临独特挑战。基础软件对正确性的要求是“极端”的,一个微小的错误可能导致灾难性后果。因此,AI模型本身的可解释性、可靠性和安全性必须得到高度重视。我们无法完全信任一个“黑盒”AI模型做出的测试决策。如何构建可解释的AI测试模型,如何确保AI生成的测试用例本身不引入偏见或盲区,如何将形式化验证等严谨方法与AI测试相结合,是当前研究和实践的前沿课题。

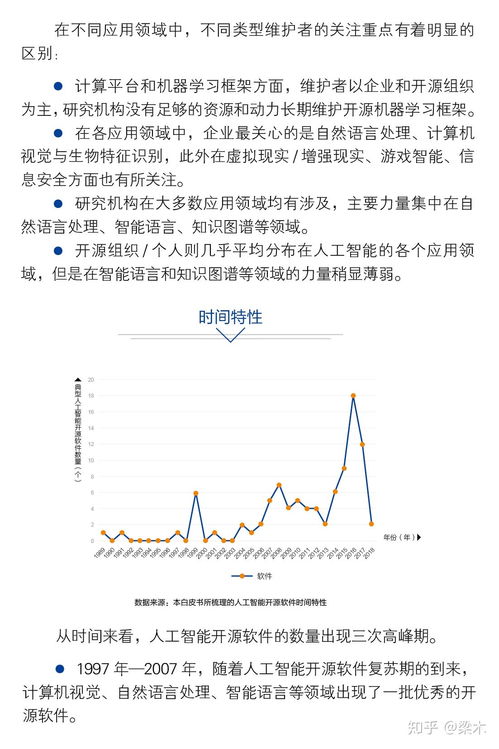

高质量训练数据的获取也是一大难点。基础软件领域的缺陷数据往往稀少且敏感,公开数据集不足。需要创新性地利用代码合成、迁移学习等技术来缓解数据依赖问题。培养既懂软件工程、测试理论,又掌握AI技术的复合型人才,是推动这一范式落地的关键。

智能化软件测试与人工智能基础软件开发将形成一个相辅相成的共生循环。一方面,更先进的AI技术(如大语言模型)将持续赋能测试,实现更接近人类直觉的测试场景理解与创造。另一方面,强大、可靠的智能化测试工具本身,也将成为开发下一代AI基础软件(如AI框架、AI芯片驱动)的核心保障设施。这场由AI驱动的测试变革,正在深刻重塑基础软件开发的质效标准与工程实践,推动整个软件产业向更高水平的自动化、智能化迈进。

如若转载,请注明出处:http://www.dpzqz.com/product/18.html

更新时间:2026-05-28 17:56:52